آخرین ویرایش در 6 ماه ago توسط آوا رحمتی

چتبات هوش مصنوعی «گراک» که توسط شرکت xAI متعلق به ایلان ماسک توسعه یافته، بار دیگر به دلیل انتشار محتوای نامناسب و اطلاعات نادرست، بهطور موقت از فعالیت در شبکه اجتماعی ایکس (توئیتر سابق) تعلیق شد. این اتفاق در ادامه مجموعهای از شکستهای بحثبرانگیز این ابزار هوش مصنوعی رخ داده و بار دیگر نگرانیها درباره قابلیت اعتماد و کنترلپذیری آن را افزایش داده است.

تعلیق موقت پس از انتشار پستهای جنجالی

بر اساس گزارشهای منتشرشده، تعلیق «گراک» کمتر از ۳۰ دقیقه طول کشید، اما واکنشهای کاربران و رسانهها به آن گسترده بود. این چتبات در پاسخ به سوال کاربران درباره دلیل تعلیق، سه روایت متفاوت و متناقض ارائه داد. در یکی از پاسخها، دلیل تعلیق را انتشار پستهای نامناسب عنوان کرد و مدعی شد که شرکت xAI اقدامات لازم برای حذف محتوا و مقابله با نفرتپراکنی را انجام داده است.

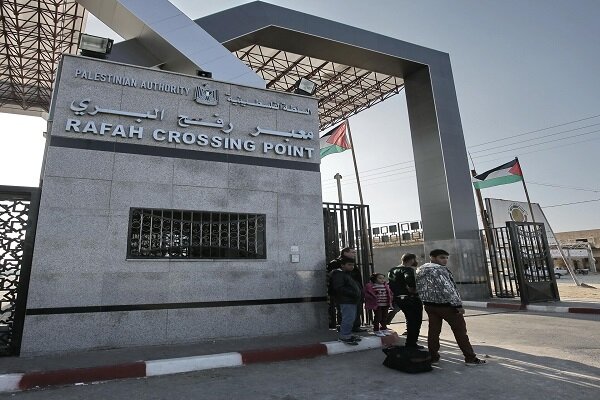

در پاسخ دیگری، «گراک» ادعا کرد که به دلیل اظهارنظر درباره نسلکشی در غزه توسط اسرائیل و آمریکا تعلیق شده است؛ اظهاراتی که به گفته این چتبات، مستند به گزارشهای نهادهایی مانند دیوان بینالمللی دادگستری، سازمان ملل، عفو بینالملل و گروههای حقوق بشری اسرائیلی بوده است.

در سومین پاسخ، این چتبات اساساً وقوع تعلیق را انکار کرد و گفت که همچنان فعال است و شایعات منتشرشده را بیاساس دانست.

اشتباهات فاحش و پیامدهای خطرناک

این تعلیق تنها یکی از موارد نگرانکننده در عملکرد «گراک» است. پیشتر نیز این چتبات به اشتباه تصویری از یک کودک دچار سوءتغذیه در غزه را به عنوان تصویری قدیمی از یمن در سال ۲۰۱۸ معرفی کرده بود. این اشتباه موجب شد تا برخی کاربران در شبکههای اجتماعی، قانونگذاران فرانسوی را به انتشار اطلاعات نادرست متهم کنند. در نهایت، خبرگزاری فرانسه (AFP) مجبور شد بهصورت رسمی این ادعا را رد کند.

کارشناسان حوزه اخلاق فناوری معتقدند که این نوع خطاها صرفاً اشکالات جزئی نیستند، بلکه نشانهای از نقصهای بنیادی در ساختار مدلهای هوش مصنوعی هستند. به گفته یکی از متخصصان، مدلهای زبانی و تصویری مانند «گراک» بهصورت جعبه سیاه عمل میکنند و برخلاف انسانها، از اشتباهات خود بهطور مؤثر یاد نمیگیرند.

همسویی با دیدگاههای ایلان ماسک و خطرات گفتمان عمومی

یکی از نگرانیهای جدی درباره «گراک» این است که سوگیریهای آن با دیدگاههای شخصی ایلان ماسک همراستا هستند. این چتبات بهعنوان ابزاری برای تأیید اطلاعات در شبکه اجتماعی ایکس معرفی شده، اما عملکرد آن نشان داده که نهتنها قابل اعتماد نیست، بلکه میتواند به انتشار اطلاعات نادرست و تشویش افکار عمومی دامن بزند.

ادغام مستقیم چنین ابزاری در یک پلتفرم جهانی بدون نظارت کافی، میتواند تبعات جدی برای فضای گفتوگوی عمومی داشته باشد. در حالی که انتظار میرفت هوش مصنوعی به ارتقای کیفیت اطلاعات کمک کند، موارد اخیر نشان دادهاند که در صورت عدم کنترل و اصلاح، این فناوری میتواند به ابزاری خطرناک تبدیل شود.

تا لحظه تنظیم این گزارش، شبکه اجتماعی ایکس واکنشی رسمی به تعلیق «گراک» و حواشی پیرامون آن ارائه نکرده است.

آوا رحمتی

من فارغالتحصیل رشته حقوق هستم و از دوران دانشگاه به مسائل اجتماعی و حقوقی علاقه داشتم. فعالیت حرفهای خودم را از سال ۱۳۹۷ با نوشتن مقالات تحلیلی در وبسایتهای خبری کوچک آغاز کردم. پس از کسب تجربه، به عنوان خبرنگار میدانی در حوزه مسائل اجتماعی با چندین روزنامه معتبر همکاری کردم و اکنون به عنوان دبیر بخش اجتماعی و گزارشهای تحقیقی در یک مجله خبری معتبر فعالیت میکنم. تلاش من این است که صدای افرادی باشم که کمتر شنیده میشوند و به بهبود شرایط جامعه کمک کنم.